AI時代最難的職位!「AI道德長」如何阻止企業危機?

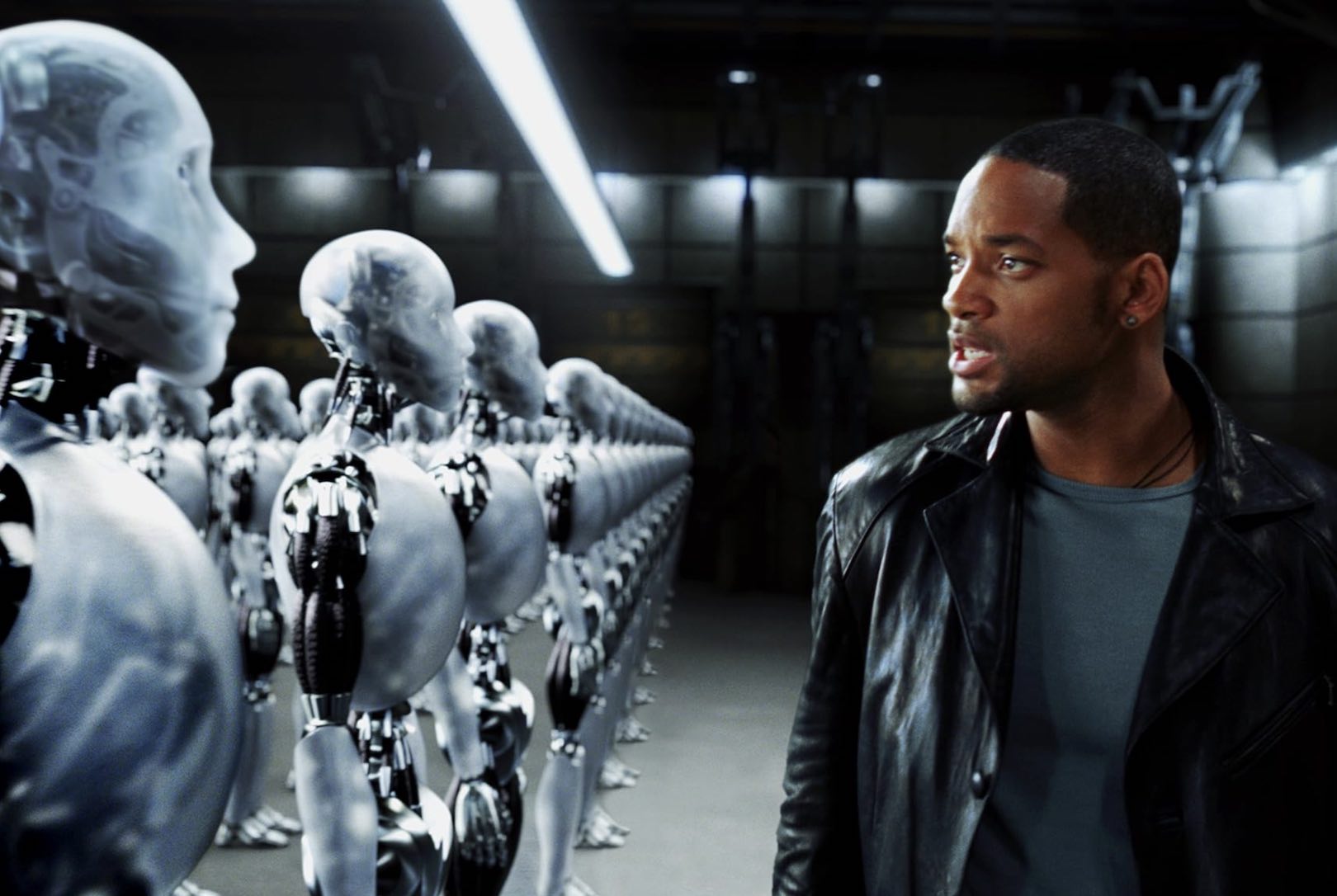

圖片來源:截自IMDb

圖片來源:截自IMDb

一台開在二線道上,煞車失靈的自駕車,繼續直行將撞上老太太;但如果切換道路,則會撞上小朋友。在這個二選一的難題裡,自駕車背後的人工智慧(AI)系統,會做出什麼決定?更直接的問題則是:誰該負責?

2023年ChatGPT劃世代的進展,象徵AI進入輝達創辦人黃仁勳所說的「iPhone時刻」:每個人都能接觸AI,並且將AI應用在自己的生活與工作上。也正是因為如此,人類也更具體感受到AI帶來的威脅——不論是個人或企業均是如此。

AI風險難控制,連奧特曼、馬斯克都憂心

正如Open AI創辦人奧特曼(Sam Altman)今年9月受邀出席《天下雜誌》AI大師論壇中提到的那個「但是」:「每個人都可以藉由AI獲得最棒的學習與醫療資源⋯⋯。但是,社會必須做出正確的決定,這麼強大的運算能力,不能被單一公司或一小群人掌握。」

這個「但是」毫無疑問,與發展AI同樣重要。就連被譽為「天才」的特斯拉創辦人馬斯克(Elon Musk)在11月1日全球人工智慧安全高峰會上也警告,「AI出現後,這是人類史上第一次面對遠比自己更聰明的事物⋯⋯。我們不知道能不能控制它,但是我們可以導引AI到對人類有利的方向。」

在AI全力加速與失控邊緣之間,企業能否建立起「負責任的AI」或是「符合道德的AI」,恐怕是遠比開發AI更困難的任務。

數字會說話:根據波士頓諮詢公司(BCG)2023年最新報告,53%的企業在導入AI工具時,缺乏自主開發能力,完全仰賴外部採購;但卻有2成企業缺乏評估AI風險能力。換句話說,有許多企業在缺乏控管的前提下,閉著眼睛讓員工或顧客暴露在AI的風險下。

「AI道德長」浮上檯面,為企業煞車

事實上,各國政府已經針對AI監管採取行動,不只歐盟最高立法機構「歐州議會」今年6月已通過AI法案,美國第一份AI行政命令也在10月31日由總統拜登簽署;台灣早在3月就由法律學者發表民間版《AI基本法》草案,並預計年底推出相關指引。

立法者動起來的同時,企業如何兼顧AI發展與法律遵循,成當務之急。這也是「AI道德長(Chief AI Ethic Officer)」這個新興職位浮上檯面的原因。

(責任編輯 / 杜韋樺)